配置ElasticSearch支持对象存储备份

1.1 前提条件

对象存储创建 bucket,获取 AK 和 SK

1.2 安装 s3 插件

| |

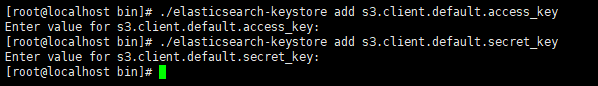

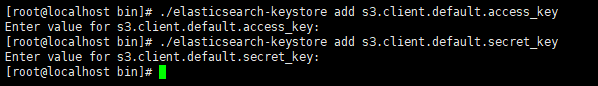

1.3 配置 s3 访问权限

1.4 配置 ElasticSearch

vim /etc/elasticsearch/elasticsearch.yml

1.5 重启 ElasticSearch 服务

| |

1.6 创建快照仓库

| |

1.7 验证存储库

| |

1.8 创建快照

| |

1.9 验证备份

| |

1.10 恢复

| |

对象存储创建 bucket,获取 AK 和 SK

| |

vim /etc/elasticsearch/elasticsearch.yml

| |

| |

| |

| |

| |

| |

| 节点IP | 节点名称 |

|---|---|

| 192.168.1.181 | consul-01 |

| 192.168.1.182 | consul-02 |

| 192.168.1.183 | consul-03 |

创建目录

| |

下载、解压安装包

下载consul压缩包,解压到/data/consul/bin/目录下

创建配置文件

| |

查看备份状态

| |

| |

| |

A 查询 IPV4 地址

AAAA 查询 IPV6 地址

CNAME 别名记录

NS 权威 DNS 服务器

MX 邮件服务器

TXT 文本记录

SOA 权威起始记录

PTR 反向解析

命令自动补全

vim /data/consul/conf/consul.json

| |

vim /usr/lib/systemd/system/consul.service

Caddy 是一个强大的、企业级的、开源的 web 服务器,使用 go 语言编写,并且可以自动配置 管理HTTPS

Ubuntu 安装

| |

RHEL 安装

| 组件名称 | 描述 |

|---|---|

| monitors | 监视器,对应的守护进程为 ceph-mon,维护集群状态的映射,包括监视器映射,管理器映射,OSD映射,MDS映射和 CRUSH映射,还负责守护进程和客户端之间身份验证,至少需要三个监视器才能实现冗余和高可用性。 |

| managers | 管理器,对应守护进程 ceph-mgr,负责跟踪运行时和 ceph 集群的当前状态,包括存储利用率,当前性能指标和系统负载,通常至少需要二个管理器才能实现高可用。 |

| osds | 对象存储这幅图对应守护进程 ceph-osd,负责存储数据,处理数据复制,恢复,重新平衡,至少需要3个 ceph osd 来实现冗余和高可用,本质上 osd 就是一个 host 主机上的磁盘。 |

| mds | 元数据服务器对应守护进程 ceps-mds ,负责 cephFS 存储元数据。 |

| cephfs | 分布式文件系统,类似于高可用的 NFS。 |

| RGW | 对象存储网关,提供 http |

| IP | 主机名 |

|---|---|

| 192.168.200.125 | ceph01 |

| 192.168.200.126 | ceph02 |

| 192.168.200.127 | ceph03 |

vim /etc/hosts

| IP | 主机名 | JDK版本 |

|---|---|---|

| 192.168.1.160 | pulsar-01 | OpenJDK21 |

| 192.168.1.162 | pulsar-02 | OpenJDK21 |

| 192.168.1.166 | pulsar-03 | OpenJDK21 |

| |